Violència sexual

Oportunitat perduda per combatre el porno ‘deepfake’ des del Codi Penal

El Parlament ha rebutjat criminalitzar aquestes pràctiques que afecten de manera majoritària dones

El fiscal de la Sala de Menors: «Els adolescents fan servir la pornografia com a tutorial de l’acte sexual»

Erika Lust, directora de cine per a adults: «Els adolescents no haurien de veure cap mena de porno»

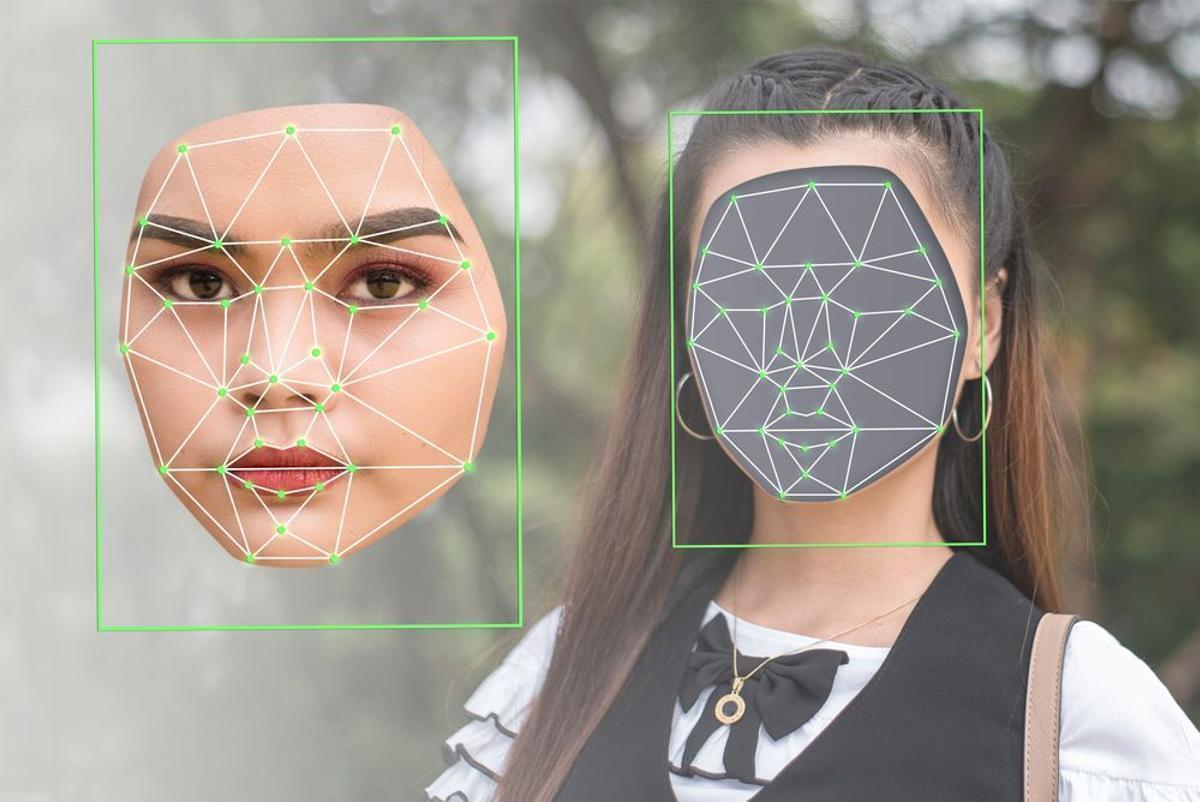

L’impacte de la pornografia, la intel·ligència artificial i la violència contra les dones suposen grans desafiaments. L’emergència del porno deepfake, continguts generats per IA a partir de l’ús no consentit d’imatges de persones reals, uneix les tres qüestions i preocupa juristes i legisladors. Espanya ha tingut una oportunitat de tipificar aquesta realitat en el Codi Penal, però el Parlament ha decidit esperar.

Cada vegada es coneixen més casos de deepfakes pornogràfics: vídeos porno realistes en els quals s’ha modificat el rostre de les actrius per introduir-hi la cara d’altres dones, que en cap moment han donat el consentiment perquè es faci. Són falsos, però l’aparença és hiperrealista.

Un desafiament per a la justícia

L’Associació de Dones Jutges d’Espanya ha alçat la veu per alertar d’aquesta «dura realitat», que constitueix «una manera d’exercir violència contra les dones».

«Desgraciadament, són moltes dones (anònimes i conegudes) les que han denunciat que el seu rostre s’ha fet servir sense el seu consentiment per crear un deepfake i, a partir d’allà, una seqüència pornogràfica, incideix l’ADJE, que cita un estudi de Senty AI en el qual s’assegura que entre el 90 i el 95% dels vídeos deepfake són pornografia no consentida.

Per a aquesta associació de juristes, es tracta d’un «desafiament» que la justícia no pot ignorar: «Queda encara un gran camí en la definició i identificació dels delictes digitals com a tals; per això moltes vegades la denúncia es tracta com un cas d’injúries o com un delicte contra la integritat moral», afirmen les jutges.

Proposta per al Codi Penal

La tecnologia (l’ús i l’abús) sempre va per davant de la legislació. Però la preocupació per l’emergència d’aquests vídeos falsos i les greus conseqüències per a les persones afectades per la seva creació i divulgació ja han escalat al Congrés i al Senat.

El Parlament tenia l’oportunitat d’incloure en el Codi Penal la criminalització específica d’aquests deepfakes pornogràfics, aprofitant la reforma de la llei del ‘només sí és sí’, però la majoria conformada pel PP i el PSOE ho ha impedit. L’argument esgrimit va ser que no era ni el moment ni la manera de legislar sobre aquesta matèria.

Va ser JxCat que va proposar la mesura dins d’un paquet d’esmenes per combatre les conseqüències perjudicials de la pornografia violenta.

La diputada d’aquesta formació, Pilar Calvo, remarca, en declaracions a EL PERIÓDICO DE ESPAÑA, del grup Prensa Ibérica, que és urgent legislar contra l’ús indegut del deepfake: «Estem davant una situació en la qual la tecnologia ens està fent anar enrere legislativament a l’hora de cobrir els forats de protecció que té el Codi Penal actual. És urgent perquè qualsevol atemptat contra l’honor ha de ser perseguit i castigat. [...] Encara no està inclòs com a tipus delictiu, però ho hauria de ser», assenyala.

El partit independentista català denuncia que aquests continguts falsos generats per intel·ligència artificial són tan versemblants que poden enganyar tant les persones que els veuen o escolten com els algoritmes mateixos.

«Quan la imatge d’una persona es fa servir per crear continguts pornogràfics o altres accions que puguin ser molt lesives per a la persona que es converteix en protagonista de manera involuntària i virtual, es menyscaba greument el seu honor o la seva intimitat. És per això que l’esmentada situació s’ha de reprovar penalment», defensava JxCat al justificar l’esmena, i també posava el focus en el fet que la creació d’aquests vídeos té «la intenció premeditada de fer mal a la persona la imatge de la qual es reprodueix».

Per això, aquest partit plantejava castigar amb penes de presó de sis mesos a dos anys qui faci servir «imatges de gran versemblança (deepfake) elaborades amb intel·ligència artificial per reproduir la imatge d’una persona o imatges reals obtingudes sense el seu consentiment amb l’objectiu de crear continguts audiovisuals que puguin ser difosos públicament per qualsevol mitjà, quan la divulgació menyscabi greument l’honor o la intimitat d’aquesta persona». I establia multes d’un a tres mesos a qui redifongués aquests continguts a terceres persones.

Populars i socialistes van declinar donar-hi suport, així que la proposta va caure en sac foradat. «No podem deixar passar aquestes oportunitats de protegir de l’ús problemàtic de la pornografia. [...] És un problema social que s’ha de corregir i solucionar ben aviat. Enteníem que la revisió de la llei del ‘només sí és sí’ era una gran oportunitat, però s’ha perdut. Haurem de continuar lluitant per aquest tema perquè la societat sí que ho té clar», emfatitza la diputada de JxCat.

Com es pot castigar el porno deepfake

deepfakeI tenint en compte aquest escenari, ¿què es pot fer si una persona es veu afectada per un deepfake fet servir per crear material pornogràfic?

L’advocat especialitzat en delictes informàtics Carlos Sánchez Almeida indica, en una conversa amb EL PERIÓDICO DE ESPAÑA, que seria correcte criminalitzar-los de manera específica. No obstant, descarta que es tracti d’un delicte contra la intimitat (perquè el cos exhibit no és de la persona afectada, el que s’utilitza indegudament és la cara), sinó contra la integritat moral.

En l’actualitat, i malgrat que no s’hagi legislat per donar una resposta específica a aquesta realitat, es podria castigar amb la legislació vigent. En concret, assenyala l’advocat, es podria aplicar tant l’article del Codi Penal sobre ciberassetjament com el que tipifica el tracte degradant contra la integritat moral.

La llei castiga l’assetjament que es produeix «mitjançant l’ús indegut» de les dades personals d’una persona i també qui utilitzi sense consentiment «la imatge d’una persona per fer anuncis o obrir perfils falsos en xarxes socials, pàgines de contactes o qualsevol mitjà de difusió pública, que li ocasioni una situació d’assetjament, fustigació o humiliació.»

A més, continua Sánchez Almeida, contra l’ús criminal del deepfake es pot aplicar l’article que castiga amb penes de sis mesos a dos anys qui infligeixi a una altra persona un tracte degradant, que menyscabi greument la seva integritat moral.

L’advocat precisa que es podria aplicar un article o l’altre, o fins i tot tots dos alhora, al jutjar aquests fets: «Assetjament o integritat moral, o els dos junts», apunta.

Així, amb la legislació actual, si una persona espanyola fos víctima d’un deepfake per generar contingut pornogràfic i ho denunciés, s’obriria un procediment judicial per aquests delictes.

Ara bé, Sánchez Almeida afegeix que s’hi podria incloure una tipificació específica, en cas que es volgués recollir més bé el delicte o incrementar la pena en un grau.

Notícies relacionadesA més de recórrer a la justícia, les persones afectades per aquestes pràctiques, en la immensa majoria dones, poden demanar l’ajuda de l’Agència Espanyola de Protecció de Dades (AEPD). En concret, del canal prioritari per «comunicar la difusió il·lícita de contingut sensible, un sistema que té per objectiu donar una resposta ràpida en situacions excepcionalment delicades, com les que inclouen la difusió de contingut sexual o violent».

Fonts de l’AEPD indiquen a aquest diari que en aquests supòsits de contingut pornogràfic, tot i que hagin sigut elaborats amb intel·ligència artificial, s’utilitzen dades personals de la persona ofesa (la imatge de la cara) que permeten identificar-la, amb la qual cosa el canal prioritari pot actuar per aconseguir la retirada d’aquests vídeos.

El 016 atén les víctimes de totes les violències contra les dones. És un telèfon gratuït i confidencial que dona servei en 53 idiomes i que no deixa rastre a la factura. També s’ofereix informació a través del correu electrònic 016-online@igualdad.gob.es i assessorament i atenció psicosocial mitjançant el número de WhatsApp 600 000 016. A més, els menors es poden adreçar al telèfon d’ANAR 900 202 010.

Les víctimes de maltractament sordes, amb discapacitat auditiva, cegues o sordcegues poden trucar al 016 en el 900 116 016, SVisual, ALBA, Telesor, Atenpro i l’’app’ PorMí. Tots els recursos contra la violència de gènere.

- Batuda coordinada Un macrodispositiu policial a Valls se salda amb 12 detinguts i més de 300 identificats

- Un viatge al passat Fires medievals per Setmana Santa a Catalunya: per pocs dies

- Conflicte regional L’Iran rebutja un alto el foc i promet continuar lluitant «mentre continuïn els atacs»

- Enric Freixa, falconer a l’aeroport de Barcelona: «Quan veus que has evitat un accident d’un avió, et sents molt satisfet»

- En família Tres excursions tranquil·les per fer aquesta primavera a Barcelona i gaudir de la natura: castells, paisatges i construccions amb història