Intel·ligència artificial

Alerta amb les fotos que puges: els ‘deepfakes’ fets amb IA que denuncia Laura Escanes inunden les xarxes socials

Aquest tipus d’aplicacions, que treballen amb fotos de persones reals, han proliferat en xarxes en els últims mesos

La llei espanyola té un buit legal per a aquest tipus de casos i distingeix entre imatges reals i realistes

Ho ha advertit la ‘influencer’ Laura Escanes aquesta mateixa setmana a Twitter: «M’ha arribat un enllaç en el qual hi ha fotos meves despullada editades i creades per IA. A part de sentir-me totalment utilitzada i exposada, hi ha una cosa que fa que em bulli la sang. El cos d’una dona no s’utilitza. Ni per al plaer, ni per abusar ni per manipular. Em repugna la persona que les hagi creat, però també els que són allà i els sembla divertit i callen».

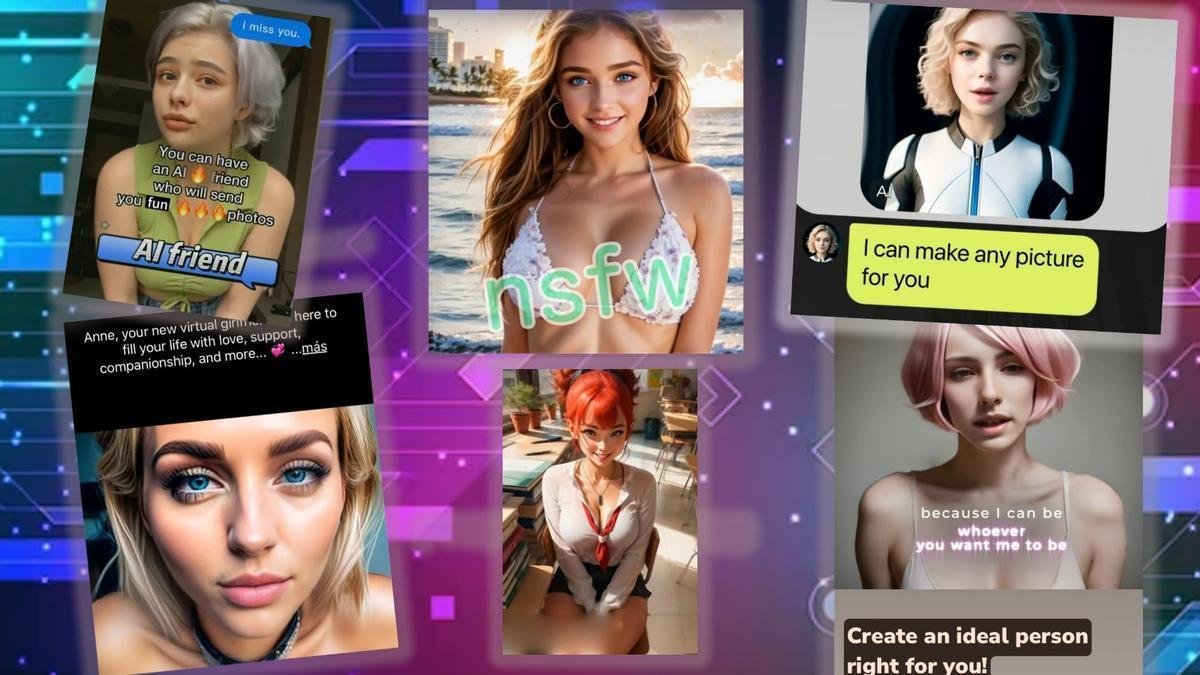

El que condemna Escanes és la proliferació d’unes noves aplicacions que utilitzen la IA (Intel·ligència artificial) per elaborar imatges de nus i escenes eròtiques amb la cara de qualsevol persona. I han inundat les xarxes socials. L’explosió de la IA va tenir lloc a finals del 2022, amb el llançament de ChatGPT. Una vegada oberta la veda, són moltes les empreses que s’han dedicat a explotar la veta. I, a internet, la veta que més diners genera és la del sexe.

Aquestes tecnologies generen imatges eròtiques realistes (que no reals). Aplicacions (n’ometrem els noms), s’han colat en les stores de tots els sistemes operatius. I apareixen com a publicitat en les principals xarxes socials. Algunes ja han sigut retirades. Però, com una hidra, renaixen amb nous noms i aparences. I les més extremes es publiciten amb unes sigles que els confereixen distinció sobre les altres: NSFW.

NSFW

NSFW és l’acrònim de ‘non suitable for work’ (no apropiat per a la feina). En realitat és un eufemisme per advertir que es tracta d’un programa que genera material sensible, per això no convé tenir-lo obert en situacions com el lloc laboral. En aquest cas, crea continguts eròtics i sexuals. Mitjançant les ordres pertinents, l’usuari es pot inventar una persona i aconseguir fotos sense roba d’algú que no existeix. ¿O sí?

Perquè el problema ve quan, com passa amb algunes d’aquestes aplicacions, es permet pujar imatges reals. Aquestes aplicacions admeten introduir fotos de cares ja existents, com el cas que ha denunciat Laura Escanes. Perquè no és necessari ser un personatge públic. N’hi ha prou que algú aconsegueixi una foto de la seva cara i la introdueixi. Tot i que el cos no sigui real, aquests programes poden generar ‘fakes’ sexuals amb la cara d’una altra persona sense que aquesta se n’assabenti.

Aquest tipus d’aplicacions, que solen ser de pagament i acostumen a requerir una quota que oscil·la entre els 40 i els 70 euros a l’any, no demanen permisos de cap classe. L’usuari malintencionat pot robar una foto de la cara d’una persona en qualsevol xarxa social i construir una imatge pornogràfica amb aquest rostre, sense sol·licitar cap tipus de consentiment. No obstant, no són imatges reals. Però, ¿podrien estar incorrent en algun tipus de delicte?

El cas Atrioc

A aquest tipus de continguts se’ls diu deepfakes, terme que procedeix de fake (fals) i deep [learning] ([aprenentatge] profund), que és el conjunt d’algoritmes d’aprenentatge automàtic que utilitzen les intel·ligències artificials. Des de la irrupció de les intel·ligències artificials a internet, s’han vist alguns deepfakes ja icònics, com la foto del papa Francesc vestit com un raper de Filadèlpia.

Allò va passar al març. Dos mesos abans ja havia esclatat el primer gran escàndol relacionat amb aquest tipus de material. Un conegut streamer nord-americà anomenat Brandon Ewing i conegut com a Atrioc va ser sorprès en un dels seus directes amb una d’aquestes pàgines que generen deepfakes sexuals en una de les seves pestanyes obertes. Allà es podia apreciar que estava creant aquest tipus de material amb fotografies de dues ‘streamers’ conegudes, Maya i Pokimane.

La troballa va fer explotar el cas perquè, a més de les dues afectades, altres streamers van decidir posar-se a investigar i van trobar material amb les seves cares. No només en la pàgina en qüestió, sinó en grans portals de pornografia. Tot i que elles no havien fet absolutament res, ja hi havia vídeos sexuals seus en les principals webs porno. Una streamer coneguda com a Sweet Anita va arribar a identificar vídeos suposadament seus a Pornhub, el líder mundial del sector.

Aquella pàgina, que es deia Bavfakes, va acabar sent tancada. Principalment per l’afany de QTCinderella, una altra streamer nord-americana que es va veure involucrada a l’adonar-se que hi havia contingut explícit sobre ella en la web. Però, lluny de desaparèixer de la web, cada dia sorgeixen noves aplicacions d’aquest tipus. I les principals xarxes socials com Instagram o Tiktok no estan filtrant aquest tipus d’anuncis i els mostren a poc que s’atiï l’algoritme. I Google ofereix gairebé 120 milions de resultats en la recerca amb les paraules ‘Deepfake porn’.

La llei

És a dir, ja s’ha arribat al moment en el qual no és necessari que algú hagi creat material eròtic en la seva intimitat i s’hagi filtrat perquè vagi circulant material sexual seu. ¿Això és sancionable? EL PERIÓDICO DE ESPAÑA, del grup Prensa Ibérica, ha parlat amb Borja Adsuara, advocat expert en Dret Digital, que recorda que «fa temps que adverteixo d’aquesta situació», fins al punt d’haver escrit una miniguia sobre aquests termes «amb la idea de ser ben didàctic». Perquè cada vegada s’obren més dubtes legals amb l’avenç d’aquestes tecnologies.

«Aquí la qüestió és que estem parlant d’imatges realistes, però no reals. La llei fa aquesta diferenciació. Les primeres podrien passar per reals perquè estan creades per les IA. Les segones sí que són fotos o vídeos que es van fer en algun moment. I, curiosament, la llei sí que sanciona les imatges realistes d’índole sexual amb menors. No fa falta que hagin passat. El fet que es generin ja és delicte».

Però, en el cas dels adults, «no està contemplat. I la solució seria fer un retalla i enganxa de la definició de ‘pseudopornografia infantil’ i aplicar-la també als adults. Però no s’ha fet de moment. I tot això que estan generant les IA és una cosa que s’haurà de legislar. Perquè. fins ara, les coses eren diferents i han anat canviant».

El cas Hormigos

Abans, la difusió d’imatges sexuals reals no estava sancionada si la persona havia donat el consentiment per captar-les. Però això va canviar el 2015», diu Adsuara. Va ser després del cas d’Olvido Hormigos, l’exregidora socialista de Los Yébenes (Toledo), que va patir la filtració d’un vídeo íntim.

«A partir d’allà, la llei va canviar i ja no es podien difondre sense el consentiment de la persona. Va ser el cas més conegut, però n’hi va haver i n’hi ha molts. És la denominada pornovenjança: una persona consent filmar-se o fotografiar-se en moments íntims amb la seva parella. Després trenquen i l’ex, per venjar-se, difon les imatges. Després del canvi de la llei, no es pot difondre si la persona gravada no ho permet».

Adsuara també cita «el cas de la treballadora d’Iveco que es va acabar traient la vida perquè van compartir un vídeo sexual seu entre els companys. No es va suïcidar per la difusió del vídeo, sinó per la humiliació a la qual va ser sotmesa després». I, fins i tot, hi ha altres casos en els quals s’atribueixen a una persona imatges que no són seves, «com un soldat que va compartir la foto d’una dona a la dutxa que s’assemblava a una companya. Ni tan sols era ella, però va servir perquè aquesta persona, que no sabia res ni era la protagonista de la foto, fos vexada».

Similar a aquest últim, el lletrat recorda que en l’esfera política espanyola ja s’ha donat un cas molt semblant: una persona va compartir per xarxes una foto d’una dona en ‘topless’ i va assegurar, falsament, que es tractava de Teresa Rodríguez, la dirigent d’Endavant Andalusia.

Delicte contra la integritat moral

Notícies relacionadesSi una persona es troba amb la situació que han difós material sexual fals amb el seu rostre (fotos o vídeos), podria perseguir-se amb l’article 173.1 del Codi Penal: «El que infligeixi a una altra persona un tracte degradant i menyscabi greument la seva integritat moral serà castigat amb la pena de presó de sis mesos a dos anys).

L’advocat insisteix que la llei ha de servir «no només per castigar, sinó també per dissuadir. Les normes tenen una ‘dimensió axiològica’ [valors], que, en altres paraules, és com quan es diu a un nen «això no es fa». I aquest missatge no calarà fins que vagi algú a la presó per crear amb intel·ligència artificial i difondre imatges sexuals falses d’una altra persona sense el seu consentiment. Serà l’únic que aconsegueixi dissuadir la resta».

- Sanció a Sant Pau per "errors" en la detecció del nadó maltractat

- Salut reforçarà la formació sanitària en violència infantil

- Protecció de la infància "No donem res per descomptat"

- Lletres que cuiden (i III) Llegir SanaMent per Sant Jordi: comunitat, espiritualitat, salut mental i gestió de l'estrès

- Ciclisme Una gran Paula Blasi acaba tercera a la Fletxa Valona